透视智谱 MiniMax招股书 AI公司担心的事情也在影响你

21世纪经济报道记者 王俊 实习生 蔡欣佁

12月19日、21日,“AI六小龙”智谱和MiniMax在48小时内先后通过港交所聆讯,并披露了招股书。

图片来源于网络,如有侵权,请联系删除

对两家公司千页招股书里的商业模式、财务表现已有不少解读,但在商业故事之外,我们发现还有很多亮点值得关注,包括大模型的叙事变化与合规担忧:

1、安全、可信成为大模型竞争力的重要维度

安全、可信不再是被动披露的“成本项”,而是直接关系到产品是否稳定可用、能否可靠落地。无论是对模型幻觉率的控制,还是对数据治理、安全体系的投入,智谱与MiniMax都将其作为产品力强调。

图片来源于网络,如有侵权,请联系删除

2、版权纠纷仍是达摩克利斯之剑

在大模型几乎虹吸互联网数据的背景下,内容版权已成为大模型公司绕不开的系统性挑战。Minimax在海外遭遇迪士尼、环球影业和华纳兄弟版权狙击,公司选择在招股书中首次做出回应。

3、 用户素养问题更加重要

图片来源于网络,如有侵权,请联系删除

随着AI产品向更广泛人群扩散,“用户究竟会使用AI做什么”,直接牵动大模型公司的合规设计和商业策略。

4、监管环境的不确定影响企业预期

在所有不确定性之上,监管环境仍是影响企业预期的关键变量。尤其是对于快速发展的AI技术,规则体系仍在建设之中。而出海企业还要面临海外监管的双重不确定性,是一项长期经营风险。

一、安全、可信成为大模型竞争力的重要维度

不少行业在发展早期,往往走“野蛮生长”的路径。在商业发展与安全合规的天平中,安全合规由于成本高、回报难量化,往往不被优选。

但这种选择在AI发展过程中发生了变化,安全合规、可信成为大模型竞争力的体现,而非累赘。

MiniMax在招股书表明,其在“整个模型开发和运营的整个生命周期纳入安全治理要求”。

比如,在模型设计阶段,进行分级风险评估。在运营期间,维护持续监控和干预机制,以实时检测和筛选潜在不良输出等。

在数据处理阶段,MiniMax团队采用标注等机制净化数据。在训练及部署模型时,对安全内容输出给予奖励,对不安全内容给予拒绝和惩罚,以此对齐人类的价值观。

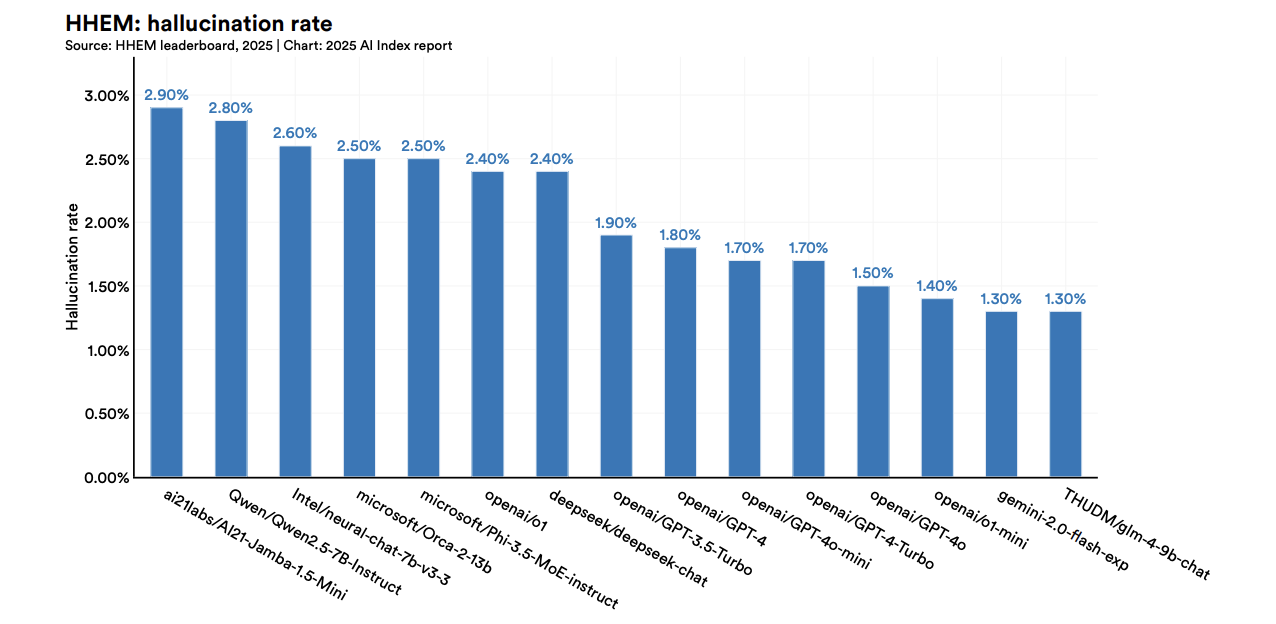

幻觉制造的虚假信息大大影响模型的可信度,幻觉率亦视为评价大模型能力的重要指标。智谱招股书中提到:根据检索增强生成(RAG)领域的LLM幻觉排行榜,GLM-45 的幻觉率为全球第二低及中国最低。足见攻克幻觉、提升可信度的难度及重要性。

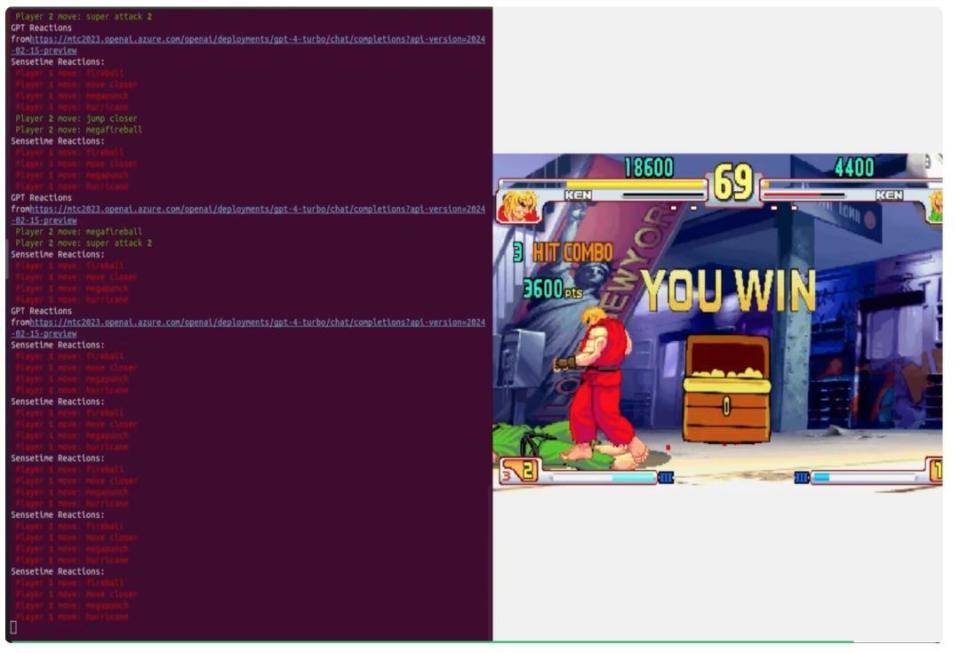

休斯评估模型向大模型发出误导性问题,依据大模型生成幻觉的频率来评估。(图/斯坦福大学《2025年AI指数报告》)

二、训练数据 & 版权纠纷的隐忧

训练数据来源是否合法合规,其中涉及到个人数据如何保护,至今仍是大模型行业反复争论的问题,也是写进招股书的长期风险。

智谱的招股书中提到,业务营运期间,可能会从第三方供应商、公共网站、公共数据集或其他公开可访问的来源获取训练数据。但智谱无法保证这些数据是合法合规的。

至于大模型在训练时使用的个人数据,其权属问题理应受到《个人信息保护法》规范。然而,由于目前的数据处理技术存在局限性,包括智谱在内也无法保证在进一步处理数据之前,能够有效地过滤、脱敏、匿名化处理自第三方供应商及公开可访问来源获得的数据,以符合相关法律法规。

许多隐忧已经升级为正面纠纷。

今年9月16日,迪士尼、环球及华纳兄弟对MiniMax旗下海螺AI提起诉讼,指控海螺AI侵害版权,最高索赔7500万美元(约合52.8亿元人民币)。MiniMax首次在招股书中否认原告的两项指控,并提出自己的抗辩立场。

该起诉讼的背景是,MiniMax的海螺AI创作并展示了多个IP角色图像,构成直接版权侵权。对此,MiniMax认为,海螺AI的内容由用户生成,并非公司行为。原告过度延伸了版权保护范围,模型开发中过程使用的训练材料,可能落入“合理使用”的范围。

针对间接侵权的指控——MiniMax应知悉用户可能生成涉及IP角色的内容,且公司从中获利。MiniMax在招股书中回应,海螺AI作为通用创作工具,其主要设计和用途合法合规。产品收费基于用户访问级别,不因生成受版权保护内容而获得额外收益,亦不存在已知或故意的侵权行为。

三、用户素养问题更加重要

随着AI产品向更广泛人群渗透,技术落地后的社会效应开始显现。今年年中时,一位国内头部AI公司的法务负责人告诉21记者,今年产品在C端快速破圈,用户画像不再局限于一线城市白领阶层,公司最近面临的一个现实疑惑是:用户到底如何理解AI,又会在实际生活中用AI去做什么。

这种用户预期,直接影响产品设计。据21记者了解,司法实践中已有多起AI产品与用户的侵权诉讼。

主营业务来自C端的MiniMax,可以视为典型。根据招股书,截至2025年9月30日,MiniMax的AI原生产品的累计用户数已增至2.12亿以上。

其中,两款情感陪伴类产品是MiniMax的重要产品线,Talkie面向国际市场,星野则在本土耕耘。招股书数据显示,两个产品用户粘性可观,Talkie/星野在全球大模型应用中平均每日使用时间排名前五,用户每天平均花费超过70分钟在这些应用上。

用户规模和使用时长快速增长的同时,未成年人保护成为无法回避的课题。MiniMax在招股书中提及,部分聊天机器人产品可能对包括未成年人在内的群体产生不良影响。

MiniMax的做法是,在模型训练、数据清洗和产品部署阶段持续关注相关风险,Talkie和星野均已上线青少年模式,并对未成年用户施加更严格的使用限制。

四、监管环境的不确定

对于颠覆性的人工智能技术,全球正在进行治理话语的竞赛。进入2025年,随着国家竞争加剧、技术快速迭代以及商业化进程推进,各国监管框架仍在持续调整之中。

这种不确定性被直接写入企业风险提示。“中国未来可能出台的法律法规或将提出更多要求与其他义务,这可能对我们的业务、经营业绩、财务状况及前景产生重大不利影响。 ”智谱的招股书中提到。

对于出海企业而言,海外复杂的监管环境也是重要变量。

MiniMax披露,其国内营收占26.9%,美国市场占20.4%。作为核心市场之一,美国的监管环境被单独展开说明。招股书详细爬梳了美国州政府层面的《加州隐私权法案》(CPRA)、《科罗拉多州隐私法案》(CPA),还提及美国联邦贸易委员会(FTC)相关的政策风向。

随着人工智能快速渗透至几乎所有行业,政府正逐步推进AI的治理和执法。这些规则变化,对于公司的业务布局与合规成本将产生实质影响。

从两份招股书的表述来看,智谱和MiniMax并未回避监管敏感议题,而是将这些行业共通痛点列为风险因素。这种主动、详尽的披露,有助于投资者全面评估风险,也为其他AI公司梳理自身合规要点提供了清晰框架。